Cognition refers to intelligent behaviour, the essential characteristic of living beings. In humans, this behaviour is based on key cognitive capacities such as perception, action, emotion, language, learning, memory, reasoning and consciousness.

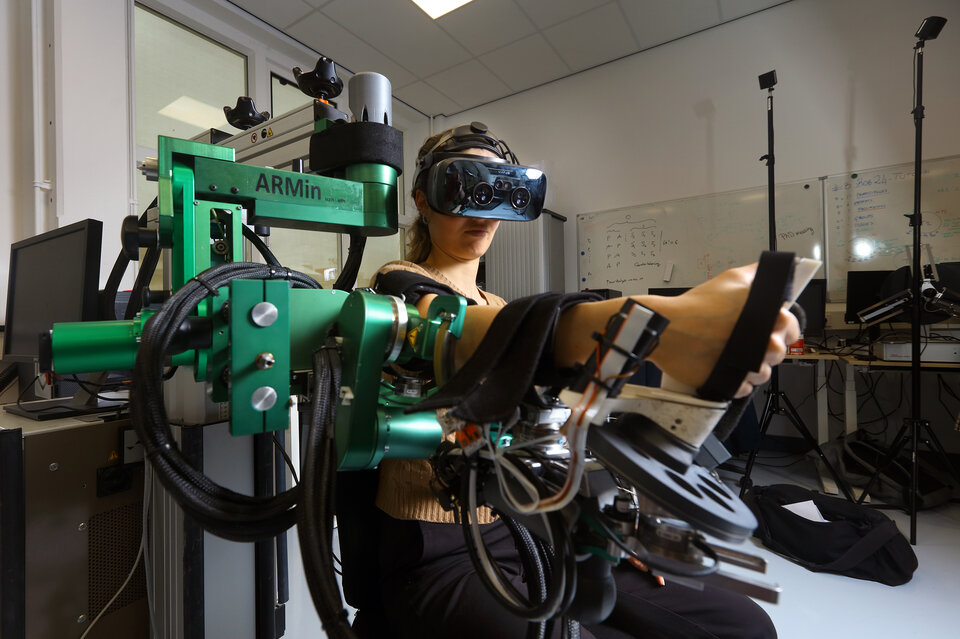

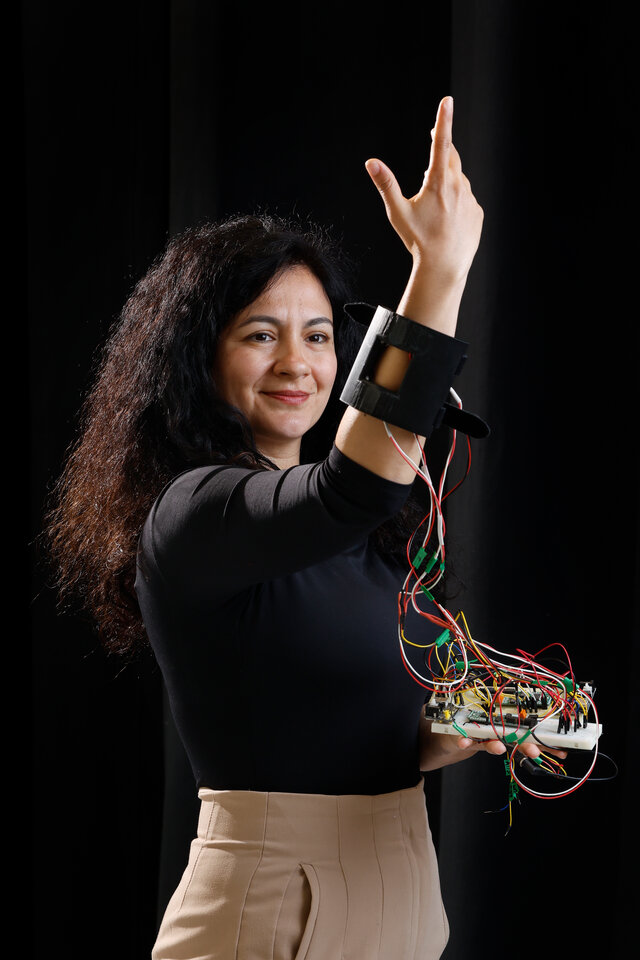

Cognitive robotics is about developing intelligence in robots. The Cognitive Robotics research group at TU Delft focuses primarily on how robots can best plan and carry out their subsequent actions, so three cognitive aspects come into play: perception, thinking and acting.

The Department of Cognitive Robotics brings together Delft robotics research, which used to be divided into two separate departments: Systems and Control and Biomechanical Engineering. Our research focuses on:

- Learning and autonomous control

- Robot dynamics

- Human-robot interaction

- Intelligent vehicles

The fundamental work of the Department of Cognitive Robotics is used in various Delft field labs, where practical robot applications are being developed and tested on a small scale (RoboHouse, SAM|XL and AIRLab Delft). From these field labs, the work eventually finds its way into practical applications in numerous industries, agriculture and horticulture, and retail.

Cooperation / partners

- Field lab RoboHouse: https://robohouse.nl

- Field lab SAM|XL: https://samxl.com

- AIRLab: https://icai.ai/airlab-delft/

- Holland Robotics : https://www.hollandrobotics.com/

- TUD Robotics Institute: https://tudelftroboticsinstitute.nl/about-us

- TUD Transport Institute: https://www.tudelft.nl/transport/

- AgTech Institute: https://www.tudelft.nl/agtech-institute/